Wuchtbrumme

Golden Noble

- Registriert

- 03.05.10

- Beiträge

- 22.289

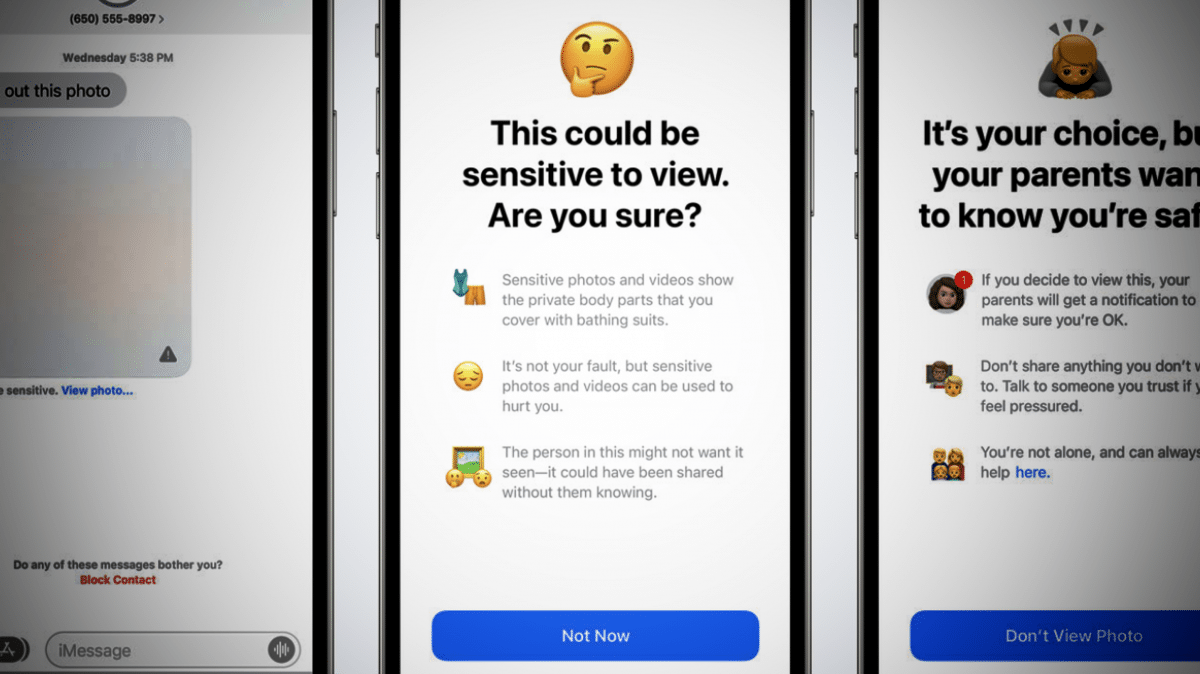

Im Sinne von Google sind Nacktfotos von Kindern wohl "schwerwiegend" genug.

Hab die letzten Postings nicht gelesen, sorry.

Edit: ...und den größeren Zusammenhang daher nicht. Ich denke, Du beziehst Dich auf den Vater, der Bilder des (entzündeten!) Genitalbereichs seines Kindes zur telemedizinischen Untersuchung geschickt hat. Dass google den Account gesperrt/gelöscht hat, ist ja wohl noch das kleinste Übel. Eine polizeiliche Durchsuchung ist ja wohl krasser und in unserer heutigen Welt reicht ja schon das Gerücht, dass sich Frau/Verwandte/Freunde von einem abwenden und man Job/Haus usw. verliert.

Zuletzt bearbeitet:

wir sind alle save

wir sind alle save